Parte 3/3

Gioco di specchi

Un esempio concreto di gioco di specchi è dato dai social bot e dagli account automatizzati: software di IA che generano o condividono contenuti in rete simulando utenti reali. Se vengono programmati (o addestrati) per sostenere una certa propaganda – cosa non rara, ad esempio, nei periodi elettorali o nelle campagne di disinformazione orchestrate – possono creare l’illusione di un ampio consenso da una parte e accrescere il clima di polarizzazione.

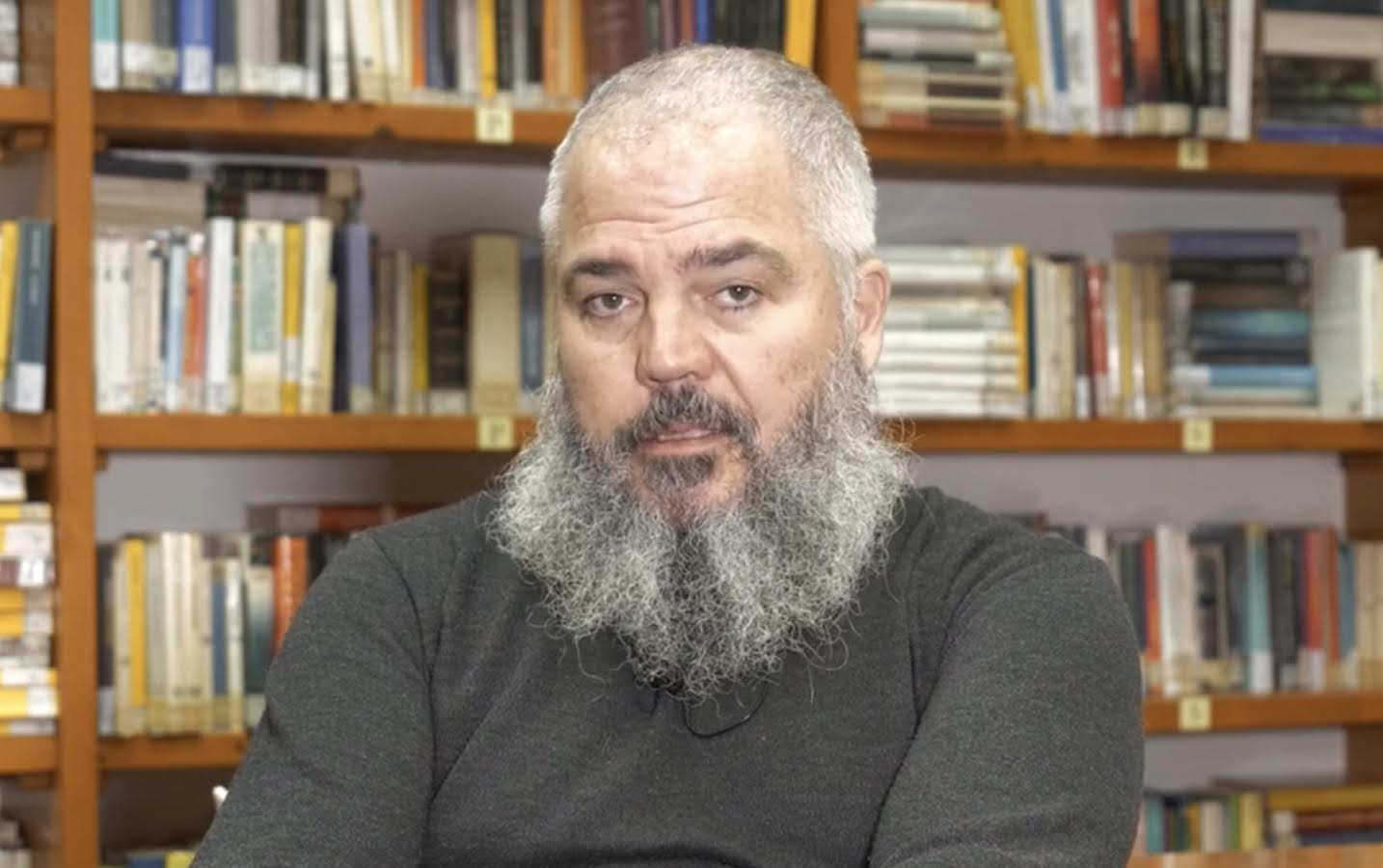

Esempi autoritari

In alcuni regimi autoritari, tali strumenti sono usati sistematicamente: come spiega Cherian George, i governi illiberali oggi dispongono di un arsenale digitale che va dalla censura online alla disinformazione automatizzata fino al mobilitare “folle” intolleranti sul web per attaccare nemici politici. Sono vere e proprie troll farm alimentate da AI e eserciti di bot che inquinano il discorso pubblico, amplificando teorie del complotto e seminando odio su larga scala.

Esempi democratici

Anche nelle democrazie avanzate, però, il problema dei bias algoritmici è all’ordine del giorno. Basti pensare alle polemiche su alcuni algoritmi di moderazione dei contenuti accusati di trattare in modo imparziale idee politiche diverse, o ai modelli di linguaggio (come i chatbot avanzati) che, frugando nell’immenso corpus di testi del web, talvolta riproducono stereotipi o inclinazioni politiche presenti nei dati.

Le verità neutrali

Ad esempio, c’è chi ha notato che certi sistemi di IA generativa forniscono con più facilità risposte “liberali” su temi etici o, viceversa, possono scivolare in affermazioni discriminatorie se stimolati con terminologie razziste presenti nei dataset. Questi non sono comportamenti coscienti – l’IA non ha ideologie – ma sono indizi di come i pregiudizi umani possano insinuarsi nei sistemi automatizzati. Se le fonti di addestramento sono polarizzate o squilibrate, l’intelligenza artificiale tenderà a normalizzare quelle polarizzazioni, restituendole come fossero verità neutrali.

Va detto che l’IA, di per sé, non “decide” di essere di parte: siamo noi a influenzarla attraverso le scelte di progettazione. Un algoritmo di ranking di una piattaforma sociale, ad esempio, può aver imparato che contenuti aggressivi generano più engagement e quindi premia quelli – ma perché è stato ottimizzato per massimizzare l’engagement, non per migliorare la qualità del dibattito. Allo stesso modo, un modello linguistico produce risposte basate sui testi che ha assimilato: se nel suo corpus c’è più testo proveniente da blog complottisti che da enciclopedie, è probabile che dia peso a certe tesi estreme.

La sfida

Logiche algoritmiche apparentemente tecniche possono avere effetti molto politici. La sfida allora diventa: come evitare che l’IA incorpori le polarizzazioni esistenti e le amplifichi ulteriormente? Una strada è migliorare i dati di addestramento – ad esempio assicurandosi che un sistema di news AI attinga a una varietà bilanciata di fonti, evitando il dominio di una sola campana.

Un’altra strada

Un’altra strada è introdurre metriche diverse oltre al semplice click: per valutare il successo di un algoritmo potremmo considerare anche l’impatto informativo, la soddisfazione dell’utente nel lungo periodo, o persino indicatori di “qualità democratica” del feed.

Inoltre, sta crescendo la consapevolezza sull’importanza della trasparenza: capire perché un certo contenuto ci viene mostrato permette di sviluppare pensiero critico e di non prendere ogni feed come una finestra oggettiva sul mondo.

Esempio europeo, il DSA

L’Unione Europea, ad esempio, con il recente Digital Services Act sta iniziando a chiedere alle grandi piattaforme maggiore apertura sugli algoritmi e interventi per mitigare i contenuti d’odio e disinformazione. Sono segnali di un tentativo di correggere la rotta e assicurare che l’innovazione tecnologica non vada a scapito del dibattito pubblico civile.

Un binomio complesso

In definitiva, l’intelligenza artificiale e la polarizzazione formano un binomio complesso. Da un lato, l’IA nei media e sui social può comportarsi come un potente amplificatore delle divisioni, perché sfrutta (anche involontariamente) le nostre debolezze cognitive e le logiche di mercato che premiano il clamore. Dall’altro, la stessa IA potrebbe diventare parte della soluzione, aiutandoci a filtrare le falsità, a esporci a idee diverse e a ritrovare un terreno comune informato.

Allo stesso modo, se guardiamo all’IA come entità autonoma, dobbiamo riconoscere che essa riflette ciò che le insegniamo: può riprodurre bias e polarizzazioni presenti nei dati o, con le giuste contromisure, attenuarli.

Servono dunque consapevolezza e responsabilità sia da parte dei professionisti dell’informazione sia da parte di chi progetta gli algoritmi. Già molti giornalisti hanno iniziato a interrogarsi su come non esasperare inutilmente i conflitti e mantenere fede a principi di accuratezza e pluralismo. Allo stesso modo, gli sviluppatori e le grandi piattaforme tecnologiche sono chiamati a farsi carico dell’impatto sociale delle proprie creazioni, per evitare che la ricerca del click facile o di modelli “efficienti” finisca per esasperare le spaccature nella società.

In altre parole

In altre parole, combattere la “polarizzazione artificiale” richiede uno sforzo congiunto: formare ed educare gli attori dell’ecosistema mediatico a gestire meglio la polarizzazione, sia quella veicolata dalle notizie, sia quella codificata nelle linee di codice. Solo così potremo sperare di sfruttare l’intelligenza artificiale come strumento di arricchimento informativo e non come fattore di divisione, preservando un dibattito pubblico sano nell’era digitale.