Parte 2/3

Mitigazione

Di fronte ai pericoli riportati nella parte 1, l’intelligenza artificiale può fare qualcosa anche in positivo? In teoria sì. Gli algoritmi non devono essere per forza progettati per massimizzare i nostri istinti più viscerali; potrebbero anche essere impiegati per mitigare la polarizzazione.

Ad esempio, piattaforme e ricercatori stanno esplorando soluzioni per rompere le bolle informative: sistemi di recommendation che, invece di assecondare sempre le preferenze dell’utente, ogni tanto mostrino prospettive diverse (counter-ranking), o strumenti che segnalino contenuti potenzialmente falsi o estremi prima che diventino virali. In ambito giornalistico, c’è chi già applica accorgimenti “antidoto”: alcuni reporter adottano tecniche di de-polarizzazione attiva, fornendo deliberatamente un’informazione più equilibrata e pluralista.

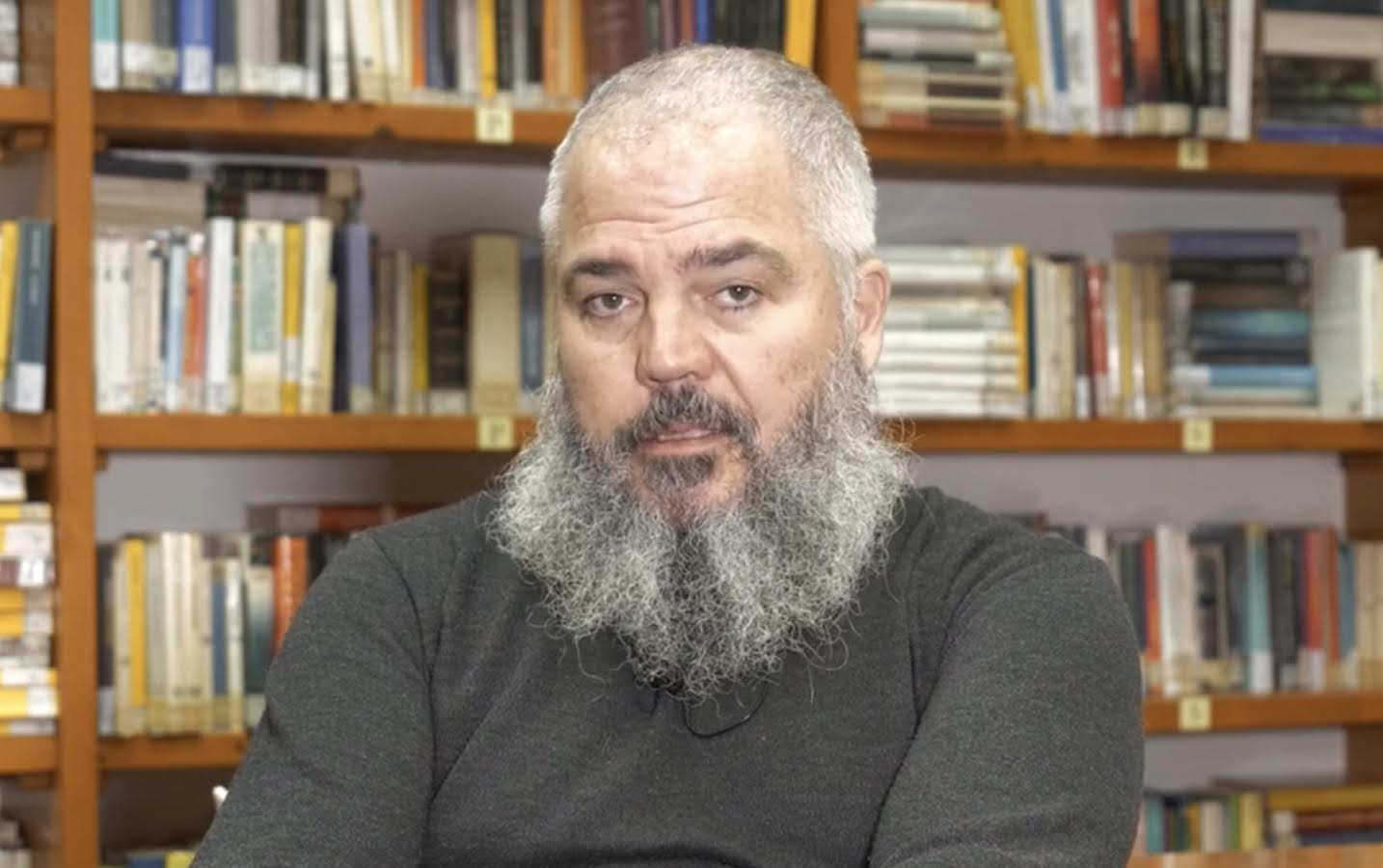

Dalle interviste di Splendore e Piacentini emerge un vero e proprio approccio “mitigativo”: dare spazio a tutte le voci in un articolo (destra e sinistra, pro e contro), contestualizzare con dati ed esperti, usare un linguaggio sobrio evitando aggettivi infuocati, e soprattutto non mettere mai il proprio commento partigiano nei pezzi.

Informare senza infiammare

Questo stile “neutro attivo” mira a informare senza infiammare: il giornalista diventa quasi un facilitatore del dialogo, offrendo al pubblico gli strumenti per farsi un’idea autonoma invece di spingerlo in una curva o nell’altra. In modo analogo, possiamo immaginare algoritmi più “etici” programmati per massimizzare non solo il tempo di permanenza sul sito, ma anche l’esposizione dell’utente a fatti verificati e punti di vista plurali.

Certo, non è semplice: la domanda è se le aziende tecnologiche abbiano incentivi a farlo e se gli utenti stessi siano disposti a uscire dalla comfort zone delle proprie convinzioni. Ma alcuni passi iniziano a vedersi, ad esempio nelle politiche di riduzione della disinformazione su Facebook o nelle sezioni “Full Coverage” di Google News che aggregano varie fonti su uno stesso tema.

L’IA, insomma, è uno strumento: può agire come amplificatore di estremismi se tarata unicamente sul profitto e sulle nostre reazioni istintive, oppure può essere un freno alla polarizzazione se progettata con criteri di diversità e affidabilità dell’informazione.

Polarizzazioni incorporate nell’intelligenza artificiale

C’è poi un secondo livello del problema: non solo l’IA influisce sulla polarizzazione della sfera pubblica, ma può anch’essa assorbire e riprodurre forme di polarizzazione. Gli algoritmi e i modelli di intelligenza artificiale apprendono dai dati che forniamo loro – articoli, post, click, conversazioni – e da obiettivi impostati dagli sviluppatori (ad esempio “massimizza il tempo che l’utente trascorre sulla piattaforma” oppure “rispondi nel modo più utile possibile”).

Se questi dati o obiettivi sono distorti, l’IA finirà per avere pregiudizi (bias) incorporati che ne orientano il comportamento in modo polarizzato. Un caso lampante è quello dei dataset informativi: immaginiamo un sistema di news automation o un assistente virtuale addestrato prevalentemente su fonti di un solo orientamento politico.

Le sue risposte alle domande di attualità rifletteranno quella visione, magari enfatizzando certe narrative e ignorandone altre. Analogamente, feed e motori di raccomandazione che “imparano” dalle preferenze degli utenti rischiano di rinforzare sistematicamente le tendenze maggioritarie in quei dati, soffocando le voci alternative.

In pratica, l’IA può fungere da specchio deformante: restituisce una versione del mondo filtrata dai nostri stessi bias, chiudendoci in una camera dell’eco costruita su misura.